Como funciona

Quando você envia um arrependimento do YouTube, o vídeo e as recomendações que te levaram até ele são enviados privativamente para pesquisadores da Mozilla.

1 Clique no ícone de extensão de rosto emburrado na barra do navegador

2 Relate o vídeo e as recomendações que te levaram a ele

*Observe que apenas vídeos em inglês serão incluídos em nossa análise.

3 Envie quaisquer detalhes adicionais que você queira que a Mozilla saiba

Com a extensão RegretsReporter, você pode agir imediatamente, nos enviando vídeos recomendados que você se arrependeu de assistir, como conteúdo de pseudociência ou anti-LGBTQ+.

O formulário de denúncia pede que você nos diga mais sobre seu arrependimento no YouTube e coleta informações sobre as recomendações que o levaram ao vídeo. Ao compartilhar suas experiências, você pode nos ajudar a responder a perguntas como: que tipos de vídeos recomendados os usuários se arrependem de assistir? Existem padrões de uso que levam a mais recomendação de conteúdo lamentável? Como se parece uma entrada em círculo vicioso do YouTube e em que ponto ele se torna algo que você gostaria de nunca ter clicado?

Vamos trabalhar juntos para tornar os mecanismos de recomendação na internet mais confiáveis.

The New York Times

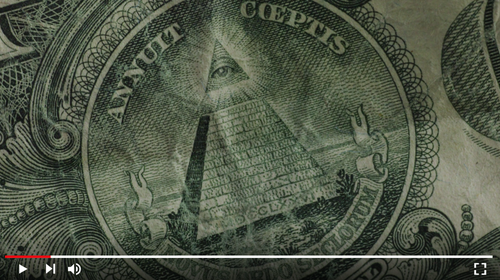

O YouTube consegue silenciar seus teóricos da conspiração?Há anos, jornalistas, pesquisadores e até ex-funcionários têm dito ao YouTube que eles precisam parar que seu mecanismo de recomendação coloque usuários em círculos viciosos de vídeos racistas, conspiratórios e outras coisas lamentáveis.

O YouTube alega estar corrigindo este problema, porém tudo ocorre a portas fechadas, sem nenhuma maneira do público saber o que está realmente acontecendo. No ano passado, a Mozilla deu ao YouTube três recomendações para ajudar a abordar este problema de forma mais aberta e transparente. Até agora, o YouTube não fez essas mudanças.

É aí que você entra. A extensão de navegador RegretsReporter da Mozilla transforma usuários comuns em vigilantes do YouTube. Podemos usar nossos próprios dados para responder dúvidas sobre recomendações lamentáveis que podem ajudar muito os jornalistas que investigam esses problemas, outros grupos como a Mozilla que pressionam por mais responsabilidade, além de engenheiros e projetistas que constroem essa tecnologia.

Sobre a Mozilla

A Mozilla está impulsionando o movimento por uma internet saudável e inteligência artificial confiável. Fazemos isso por meio de projetos como este, que responsabiliza empresas por sistemas prejudiciais de inteligência artificial. Estamos defendendo que o YouTube resolva seu problema de recomendações há quase um ano. Abaixo você encontra uma linha do tempo do trabalho da Mozilla sobre esse problema.

Uma linha do tempo do trabalho da Mozilla sobre este problema

-

Julho de 2019

A Mozilla concede a Guillaume Chaslot, ex-engenheiro do YouTube, uma bolsa para apoiar seu trabalho de investigação de sistemas de inteligência artificial, incluindo os impactos do mecanismo de recomendação do YouTube.

-

7 de agosto de 2019

A Mozilla anunciou intenções de investigar o problema de recomendações do YouTube e de iniciar um diálogo com a empresa sobre a implementação de melhorias.

-

14 de agosto de 2019

A Mozilla publicou uma lista de leitura para nossa comunidade, detalhando as maneiras como inteligências artificiais de recomendação, incluindo a do YouTube, podem manipular os consumidores.

-

3 de setembro de 2019

A Mozilla hospedou uma sessão de perguntas e respostas com um adolescente que foi radicalizado online, em parte devido à inteligência artificial de recomendação do YouTube.

-

10 de setembro de 2019

A Mozilla lançou sua campanha #YouTubeRegrets, encorajando os usuários a compartilhar histórias sobre recomendações prejudiciais que encontrarem.

-

14 de outubro de 2019

Após se reunir com a equipe do YouTube para discutir este problema, a Mozilla publicou três ações concretas que a plataforma poderia tomar para ajudar a resolver seu problema de recomendação. Essas mudanças envolvem tornar os dados de recomendação do YouTube mais transparentes.

-

15 de outubro de 2019

A Mozilla publicou descobertas da pesquisa #YouTubeRegrets, destacando como foi recomendado aos usuários conteúdos anticientíficos, anti-LGBT e outros vídeos prejudiciais.

-

26 de outubro de 2019

Na MozFest 2019, a Mozilla hospedou o "The Algorithmic Gaze”, um painel de exploração dos perigos de inteligências artificiais não confiáveis, como o mecanismo de recomendação do YouTube.

-

25 de dezembro de 2019

A Mozilla publicou uma lista contínua de negligências do YouTube relacionadas ao seu problema de recomendação.

-

Setembro de 2020

A Mozilla lança a extensão de navegador RegretsReporter para pesquisar o problema de recomendações do YouTube.

-

Julho de 2021

Usando dados fornecidos por 37.380 usuários do RegretsReporter, a Mozilla apresenta as primeiras descobertas sobre as recomendações do YouTube.